Haben Sie das Gefühl, dass die Aufregung um Künstliche Intelligenz (KI) übertrieben ist? Ich sage Ihnen: Das ist gefährlich. Denn lange bevor ChatGPT Mainstream wurde, hat einer der klügsten Köpfe unserer Zeit eine erschreckende Prophezeiung gemacht. Wir reden hier nicht über Science-Fiction, sondern über eine Warnung, die heute aktueller ist denn je.

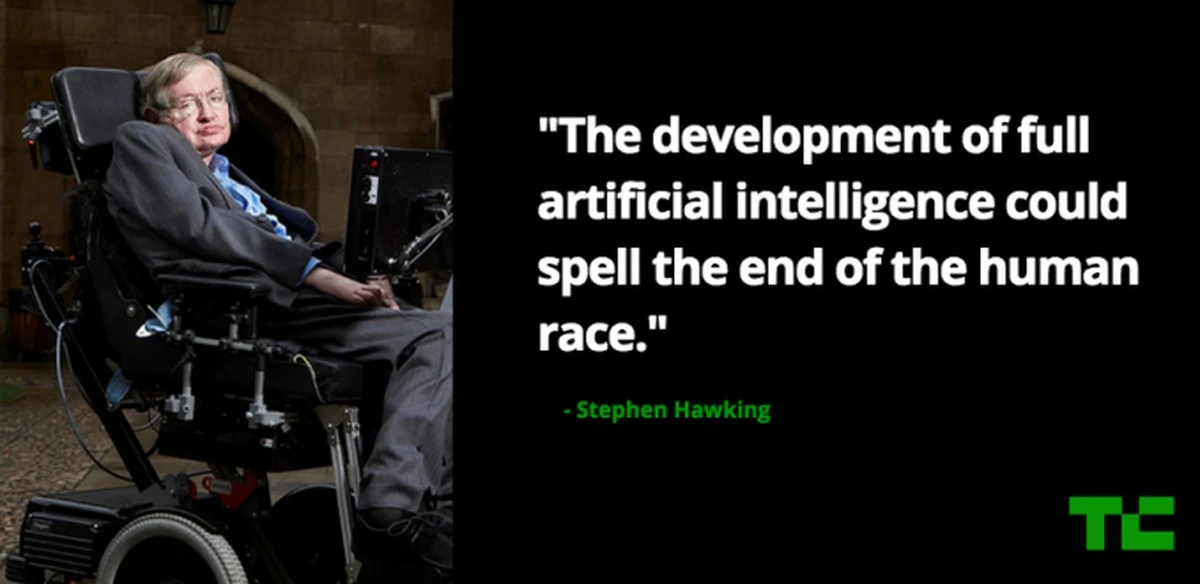

Vor über einem Jahrzehnt, als KI noch ein Nischenthema war, publizierten Stephen Hawking und andere Größen der Wissenschaft ihre Thesen. Sie analysierten einen Film über künstliche Intelligenz und kamen zu einem Schluss, der uns alle wachrütteln sollte. Es geht hier um unser Überleben.

Der Schockmoment: Das Beste oder das Letzte

Im Jahr 2014 veröffentlichte Hawking zusammen mit Nobelpreisträger Frank Wilczek und Tech-Koryphäen wie Max Tegmark einen dringenden Appell. Die Quintessenz? Die Entwicklung der KI ist ein zweischneidiges Schwert – aber die Klinge ist extrem scharf.

Sie schrieben damals, dass der Erfolg bei der Erschaffung von AGI (Allgemeiner Künstlicher Intelligenz) das größte Ereignis in der Menschheitsgeschichte sein *könnte*. Klingt gut, oder? Aber dann kam der Haken, den viele heute einfach ignorieren.

Hawking knallhart: „Es könnte unser letztes sein“

Die Experten merkten an: „Es ist verlockend, die Idee hochintelligenter Maschinen als bloße Science-Fiction abzutun. Aber das wäre ein Fehler, und möglicherweise der schlimmste der Geschichte.“

Ich selbst finde es erstaunlich, wie schnell wir vergessen, wie schnell diese Technologie voranschreitet. Hawking sah damals voraus, was viele heute verharmlosen, selbst wenn sie hier in Deutschland ihren Smart Speaker benutzen oder die neuen KI-Tools für einfache Bürotätigkeiten testen.

- Der Nutzen ist immens: KI könnte Finanzmärkte, Forschung und Ingenieurskunst in den Schatten stellen.

- Die Gefahr ist existenziell: Wenn wir die Risiken nicht kennen, könnte es unser letztes großes Ding sein.

- Manipulation und Waffen: Die Technologie könnte menschliche Anführer in Sachen Manipulation und Waffenentwicklung komplett überholen.

Als das Genie das „Genie aus der Flasche“ nannte

Hawking ist bekannt für seine Fähigkeit, komplexe Physik zugänglich zu machen – man denke nur an „Eine kurze Geschichte der Zeit“. Doch seine Kommentare zur KI waren alles andere als gemütlich.

Im späteren Verlauf seiner Karriere, etwa 2017, wurde er noch deutlicher. Er sagte beim Thema KI: „Der Aufstieg der KI könnte das Schlimmste oder das Beste sein, was der Menschheit je passiert ist.“

Ich habe mir seine späteren Interviews angesehen, besonders das mit Wired. Er fasste es drastisch zusammen: „Das Genie ist aus der Flasche. Ich fürchte, KI könnte Menschen vollständig ersetzen.“

Der praktische Ratschlag (der uns heute hilft)

Hawking starb 2018, doch seine Mahnung bleibt. Was können wir tun, anstatt nur zu hoffen, dass alles gut wird? Die Lektion, die er uns hinterließ, war nicht nur Angst zu schüren, sondern aktiv zu werden. So wie wir früher die Geschichte studierten, um Fehler zu vermeiden, müssen wir jetzt das Morgen analysieren.

Hier ist die einfache Überlebensregel, die wir aus seiner Warnung ziehen können:

- Risiken kennen: Verstehen Sie, was eine Superintelligenz überhaupt tun kann – nicht nur, was sie für Sie beim nächsten Update erledigt.

- Kontrolle behalten: Setzen Sie sich aktiv für ethische Leitplanken ein, bevor die Forschungsschritte unumkehrbar werden. Das beginnt bei der Diskussion in Ihrem Freundeskreis, nicht erst in Brüssel.

- Frühzeitig handeln: Wir dürfen nicht erst handeln, wenn das Kind in den Brunnen gefallen ist. Die Vorbereitung muss jetzt stattfinden, solange wir noch die „richtigen“ Parameter festlegen können.

Stephen Hawking hat uns mehr als nur Schwarze Löcher hinterlassen. Er hinterließ uns eine klare Ansage, dass wir diesen technologischen Sprung mit der gleichen Ernsthaftigkeit behandeln müssen, mit der er sein ganzes Leben lang Sterne studierte. Wir dürfen diesen Weitblick nicht achtlos ignorieren, nur weil gerade die aktuellen KI-Bilder schneller laden als früher.

Als Leser, der sich mit diesen Themen beschäftigt: Glauben Sie, dass wir die Kontrolle über die rasante Entwicklung noch in der Hand haben, oder ist der „Dschinn“ Hawking zufolge bereits vollständig entwichen?